Dos interesantes artículos hoy hacen referencia a experiencias que han resultado ser exitosas a la hora de eliminar de determinados servicios problemas como las noticias falsas o las dinámicas de acoso e insulto.

Dos interesantes artículos hoy hacen referencia a experiencias que han resultado ser exitosas a la hora de eliminar de determinados servicios problemas como las noticias falsas o las dinámicas de acoso e insulto.

Por un lado, Fusion publica «What GitHub did to kill its trolls«, una pieza larga y detallada sobre cómo la mayor plataforma de publicación y colaboración para software de código abierto del mundo fue capaz de conjurar un problema de dinámicas nocivas de interacción que amenazaba con convertir en muy incómoda la interacción en la página, que en el año 2014 llevaba ya algún tiempo viendo abandonos de usuarios que manifestaban quejas de trolling, bullying, machismo, abuso, acoso e insultos.

¿La receta? Equipos de gestión creados con personas de orígenes muy diversos, con muy diferentes sensibilidades con respecto a los distintos temas, y muy comprometidos con su labor, con la idea no tanto de crear nuevas normas de conducta, sino de detectar todos los resquicios del funcionamiento del sitio que permitían o incluso fomentaban la aparición de ese tipo de dinámicas. Una respuesta muy diferente a la tomada por redes como Twitter, en las que esas dinámicas no son tristemente la excepción sino la norma, y que como mucho, llegan a ofrecer a los usuarios herramientas para que puedan llevar a cabo la absurda «estrategia del avestruz», para poder ocultarse a sí mismos las dinámicas abusivas, pretendiendo aquello de «si no puedo ver el problema, ya no existe».

En el segundo artículo, titulado «Why Snapchat and Apple don’t have a fake news problem«, Buzzfeed especula sobre las razones por las que determinadas plataformas de consumo de noticias, como Apple News o Snapchat Discover, no tienen los problemas derivados de la publicación de noticias falsas que sí sufren otras como Facebook. La respuesta, en este caso, parece clara: un nivel de control y supervisión mucho más rígido y manual, una aprobación particularizada de cada una de las fuentes, y mecanismos de interacción que no tienden tanto a premiar lo social entendido como acumulación de Likes, de follows o de algoritmos que puedan ser manipulados, sino mediante reglas mucho más sencillas, como la exposición cronológica.

No hablamos de casos aislados o poco importantes cuantitativamente: Snapchat, con sus 150 millones de usuarios diarios, supera ya en 10 millones de usuarios activos a redes como Twitter, y obtiene importantes ingresos gracias a Discover, la plataforma de compartición de noticias en la que muchísimos usuarios fundamentalmente adolescentes, que resultan muy difíciles de alcanzar para la mayoría de los medios, leen noticias de una serie de publicaciones que pasan por un riguroso proceso de admisión y control. No hablamos de un sistema en el que grupos de adolescentes macedonios puedan dedicarse a ganar un dinero generando noticias falsas que se convierten en virales, ni donde publicaciones de dudosa reputación puedan inyectar noticias completamente falsas e inventadas, sino de un sitio con reglas serias donde el derecho de admisión está claramente señalizado y tiene un coste, en absoluto trivial. En el caso de Apple News, hablamos de 70 millones de usuarios activos y de contenido disponible de más de 4,000 publicaciones, pero en la que el acceso está regulado por el miso tipo de reglas rígidas y conocidas que gobiernan la tienda de aplicaciones de la compañía: incumple las normas, y te verás rápidamente excluido.

¿De qué estamos hablando? Claramente, la responsabilidad de gestionar una plataforma debe ir bastante más allá de la posibilidad de crearla técnicamente. Si no aplicamos principios de gestión claros e inequívocos, el destino es el que es: caer víctimas de algo tan imparable como la mismísima naturaleza humana. Los problemas de las plataformas, en realidad, no lo son tanto de las plataformas como de sus usuarios, que necesitan aparentemente estar sujetos a procesos de control y supervisión que eviten que salga a la superficie lo peor de su naturaleza. Y para evitarlo, aparecen mecanismos como el control y la supervisión, expresados a través de distintos sistemas que van desde el trabajo de equipos de moderación, hasta el desarrollo de barreras de entrada. El primer caso, Github, termina por resultarme mucho más atractivo debido al componente democrático que posee: cualquier persona puede crear un proyecto en la plataforma, sin ningún tipo de limitación, y los problemas únicamente surgen si esa persona entra en dinámicas de comportamiento abusivo, momento en el que se encontrará con el equipo de gestión de la comunidad. En el caso de Apple o Snapchat, el mecanismo me resulta menos interesante: que las cosas funcionen mejor cuando las barreras de entrada son más elevadas, y como tales barreras, dejen fuera a muchos que podrían posiblemente generar contribuciones valiosas, me parece una manera de tirar al niño con el agua del baño, aunque indudablemente esté siendo capaz de probar su buen funcionamiento.

Lo que no cabe duda es que mecanismos de este tipo, en distintas combinaciones, son cada día más necesarios para gestionar plataformas en la red, y el estudio de casos como estos puede probarse muy valioso a la hora de pensar sobre ese fenómeno. El sueño buenista de una red completamente abierta y sin limitaciones a la participación ha llegado a un punto en el que, al encontrarse con lo peor de la naturaleza humana, ha terminado por probar sus numerosas limitaciones. Triste, pero desgraciadamente real.

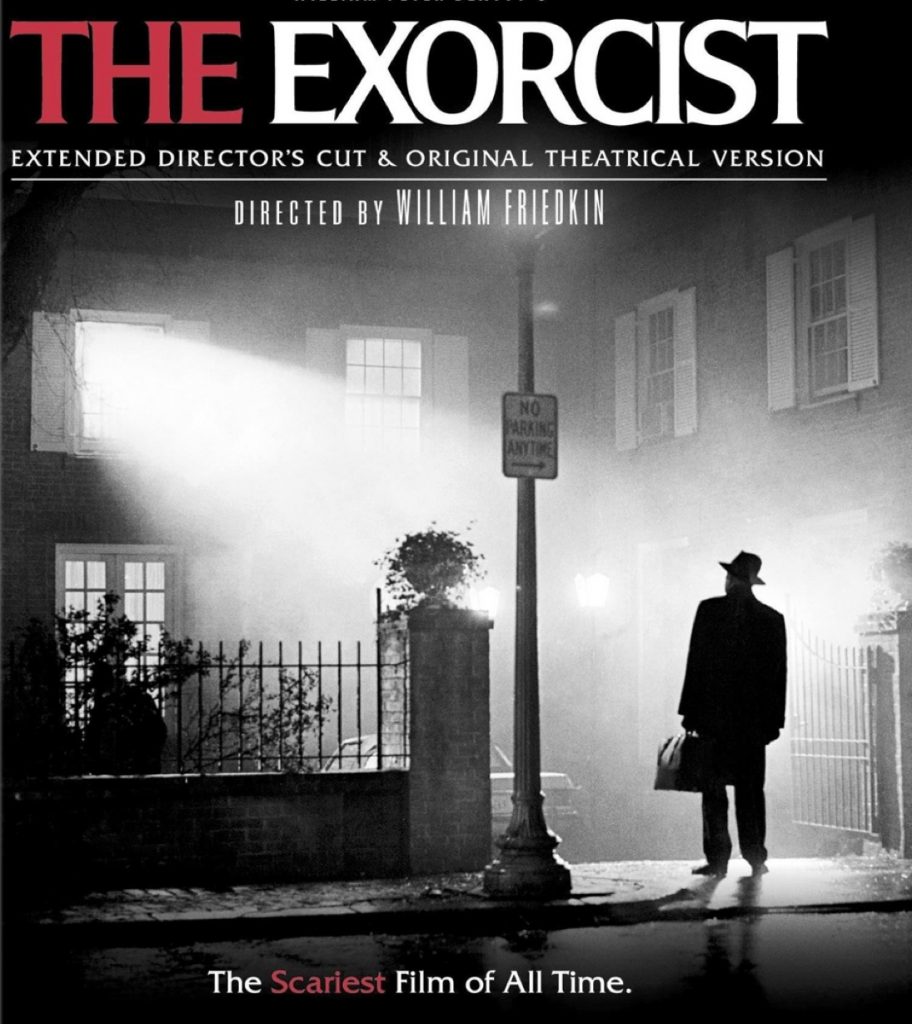

This article is also available in English in my Medium page, “Exorcising the demons of the social networks»

Todo lo que cuentas está muy bien, pero como ocurre siempre en Internet ¿Quien Paga?

Desconozco que cantidfad de Twits se envían al dia, pero suponiendo que una persona sea capaz de revisar 30 twits al minuto, Cuantos censores hacen falta?

Lo lógico seria que los usuarios, o sea nosotros mismos, pudiéramos «curar» los contenidos, y que si algo que leemos, es evidentemente falso, o exagerado, podamos enviarlo a las mismas personas que han recibido el mensaje inicial

Esto si que es posible y creo que podría funcionar, que adenás de los Likes y los retweites, hubiera una opción que permitiera un Twit de respuesta, con copia a todos los receptores del primer Twit, indicando por qué estamos discinformes con lo recibido. Bastaria que Titter «curara» estas protestas para permitir o no enviar la rectificacion a los demas,

Creo que hay aquí ahí dos casos diferentes

* Plataformas gratuitas de colaboración, p-ej- github, wikipedia, en el cual hay accesos moderados por VOLUNTARIOS, porque detrás del servicio no hay empresa haciendo su beneficio. La gente en general respeta a estas páginas no comerciales que ofrecen un servicio de Vlor añadido a la Sociedad, colaboran, y a la vez son más valoradas.

* Y por otro lado están muchos medios comerciales , llámense p.ej: ElPais, FB, Apple,quora, o este blog ( como el propio Enrique ha reconocido que es un buen instrumento de visualización aunque eso si sin publicidad explícita) que se sirven de internet para tener de una y otra manera un posicionamiento y su lucro mediante la gestión de publicidad o lo que sea.

Sra. Empresa Comercial: gstiónelo como quiera, sepa o pueda, devuelva parte de sus ganancias a la Sociedad, gáste su dinero en AI o en un ejército de efebos o vírgenes vestales del conocimiento contratadas en una ETT para censurar lo que su Dios le dió a entender. Pero no se comparen con las empresas modelo de internet.

No hay demonios en la red, sino actitudes que no gustan a los que dirigen esa web y se crea una necesidad de control, , unos lo tienen más sencillo controlar su medio gracias a que se han ganado el respeto de los voluntarios, otros usan el sistema capitalista para ganar dinero y por tanto tienen un coste extra que se llama pago por controlar mi site.

No veo el problema, son las reglas del juego.

Cada uno elige, librealbedrío le llaman.

Cuando el acto de ejercer la libertad tiene el riesgo de convertirse en libertinaje son pocas las opciones que quedan, la primera que se me ocurre es ejercer algún tipo de control a manera de filtro que proteja a los otros del abuso de unos cuantos desbordados.

Existen dos enfoques, medidas proactivas y medidas reactivas, creo que la planteada por GitHUB corresponde a medidas reactivas, primero sucede y entro a ver como lo manejo y corrijo esperando, supongo que cuantas alternativas o perfiles falsos es un primer intento de continuar intentando por parte de los malintencionados. Apple y Snapchat plantean medidas que se pueden considerar como proactivas tendientes a evitar que suceda o más bien que llegue a su comunidad el contenido dañino.

Creo que ambos enfoques actúan como barrera, funcionan como murallas que tratan de mantener su comunidad limpia de contenidos considerados dañinos, pero el problema sigue existiendo fuera de sus muros y sus representantes continúan buscando una falla en el diseño, supongo que es una contienda a la que aún le faltan mucho para llegar a un fin.

El simple hecho de que una plataforma, debate, tertulia, red social o lo que sea, se encuentre con la figura de un presentador, moderador, gestor..o similar..para poder funcionar, no significa que funcione con censura sino que funciona con una figura, ya sean una o varias personas, en la que se apoyan para el buen desenvolvimiento de la actividad.

– La opción de los voluntarios que autogestionan el evento es super interesante…puesto que funciona muy muy bien: Ya nos irán contando los de Wikipedia las técnicas que utilizan porque en cuestión de noticias se manejan muy pero que muy bien. Yo nunca les he pillado a los de la wiki intentando colármela de que los burros vuelan. Los de FB tendrían que mirarse más en el espejo de esa gran enciclopedia colaborativa para aprender a publicar con «discriminación razonable». No todo vale si te quieres convertir en un referente informativo serio y a nivel mundial.

Lo único que a los de wiki no les podemos plantear lo de los insultos y los acosos..Como poder podemos, pero está claro que como no son red social propiamente entendida, en esa enfermedad no nos pueden mostrar cuál es la cura…puede que ni la vacuna.

Con la implementación de puestos cuya responsabilidad sea filtrar comportamientos, todos los internautas habremos perdido algún trozo de esa isla paradisíaca llamada libertadtotal….Pero si me obligan a decidir, yo prefiero que alguien modere antes que ver como un negocio honesto se hunde a base de bulos ( podría tratarse de un negocio de cualquiera de nosotros )…Y aunque me fastidie que alguien me controlen, cedo sin dudar algo de mi preciada libertad, si con ello sé que un niño no tiene miedo de acudir a su colegio, que alguno se ha llegado a suicidar y todo..Que si la Red actúa como amplificador, también amplifica la dureza de los golpes sobre inocentes. Muy fuerte esto último sólo por no existir ni un mínimo de control. Inadmisible.

Que si la Red actúa como amplificador, también amplifica la dureza de los golpes sobre inocentes. Muy fuerte esto último sólo por no existir ni un mínimo de control. Inadmisible.

Sigo sin entender por qué se le puede pedir a una red social, por el hecho de ser ser digital, lo que no pedimos a las redes analógicas, como, las conversación en el bar, las cartas o el teléfono, O es que no se han hundido negocios debido a rumores, o no existe el acoso infantil por teléfono.

Pues si el tabernero no tiene por qué moderar las conversaciones entre los amigos, y Telefónica no tiene por qué moderar las conversaciones entre abonados, no entiendo por qué Twitter o Facebook han de tener que moderar las conversaciones entre usuarios, cuando además estos siempre están identificados, aunque sea por un seudónimo.

Una cosa es que sea bueno que lo hagan y otra muy distinta, es que sea su obligación ¿Por qué ha de serlo?

Toda empresa y proyecto tiene una responsabilidad con la sociedad, mas aún si su modelo de negocio esta estructurado en la interacción entre personas.

La misma tecnología que les permite operar y recaudar millones de dolares, les permite asumir la responsabilidad de por lo menos intentar ayudar en la mitigación de un fenómeno dañino para la sociedad.

El problema quizás no sea nuevo pero la forma en la que se realiza la interacción si ofrece ahora opciones que antes no existían.

Telefonica recauda millones y nadie le pide que free los bulos que corren por sus líneas. Mas justificado seria pedírselo a ella que es a su vez red social y soporte físico de todas las redes. Al fin y al cabo hoy twitter se sigue tanto por Internet como por teléfonos móviles,

El recaudar millones no lo veo un motivo, máximo si los recauda de publicida y no de hacer los contenidos.

Pues porque de otro modo, lo que están ofreciendo no funciona.

Hace 3 meses que gestionamos esta cosa: montandotunegocio.com; que es un agregador de enlaces a páginas web sobre locales comerciales en alquiler.

La idea es que agentes con intereses en el sector (inmobiliarias, arquitectos, diseñadores, constructores, asociaciones de vecinos, de comerciantes, de barrios o de algún sector productivo como peluqueros u hosteleros) voten y comenten cada local publicado de acuerdo a las ventajas e inconvenientes que presenta para un uso en concreto.

Así la gente que busca lo hace con búsquedas tipo «local para bar» y aparece un listado ordenado de los mejores locales «para bares»; y ese orden sale de la participación de toda la tropa descrita anteriormente.

Si esa «tropa» se dedica a votar positivo al suyo y negativo a los de los demás, el sistema no funciona y lo que estás ofreciendo es un cuento.

SOLUCIÓN: tener muy controlado quien vota qué y por qué… algo parecido a lo que hacen en meneame.net (que tampoco pongo como ejemplo); en el que los propios «votantes» se autoregulan.

Vd es muy dueño de llevar su negocio como quiera. pues es suyo. Pero el m negocio de Facebook consite en que unos amigos siguen lo que cuentan otros amigos y el dueño solo pone el tablón de anuncios.

Si mis amigos se dedican a hablar de perritos, la culpa en todo caso será mía. por seguir a esos señores, pero no puedo decir que Facebook es cursi, Facebulk pone el tablón de corcho y es absolutamente neutra, salvo en los anuncios que ella aprovecha para poner en el tablón. .

De la misma forma, si mis amigos se dedican a decirme Gafotas y Gordinflón, no es culpa de quien pone el tablón de anuncios, sino de los que coloca los carteles en él.

Ese trozo del puente parece que se tambalea y nadie le hemos dado una miradita…simplemente insistimos en que se pase por ahí ¿verdad? Haces bien en replantearlo.

La gente que lo sugerimos esto, yo pienso, es por «menos malo» que la inacción actual, además de «muy factible» y también «muy fácil» de llevar a cabo..y más con la cantidad herramientas que cualquier administrador de red social tiene a su disposición…

– Las cartas: van de A hasta B, comunicación privada; con secreto de correspondencia amparado por ley; competencias del Repartidor: Cero; herramientas cero; veces que se acosa por carta: muchas menos..no es Red social..no se multiplica el efecto, insisto.. va punto a punto..y en privado..Un cartero por la calle no tiene competencias, ni herramientas..ni forma de regular eso ordenador en mano y de una forma funcional, no puede hacerlo..eso es un desastre..no le puedes exigir eso a un Cartero-a..no le toca…

¿ Qué te parecería que tus cartas te llegasen abiertas por la solapa ? Eso es muy chungo de hacer en los «escenarios analógicos» que tú muy bien comentas.

– En cambio, en el «escenario digital» la película cambia completamente Gorki: eso ya es otro «planeta» diferente..con otros peligros y soluciones distintos:

PERO: Si desde 1 perfil de tu red alguien clica en el icono «Señalizar» o «Denunciar abuso»..Y además especifica el motivo en un pequeño cajetín de mensaje: pues YA te está diciendo: «entra a mirar esta mi conversación..Estoy teniendo un problema con algo..o con alguien..O necesito tu Ayuda.. por alguna razón….»

Yo creo que la gente lo sugiere porque es razonable que así sea..( y no se van quejar de intromisión después de solicitar ayuda..) Es otro planeta, funciona todo con otras leyes…

En otro ratito ya te daré motivos si quieres de por qué también es distinto con el teléfono y eso… :-)

No todo son cartas también hay postales y nadie pide que se garantice la veracidad de lo que en ellas se cuenta. Y niego la mayor, lo digital no es otro planeta, solo son nuevos canales de comunicación, donde muchos son simétricos, como lo es el teléfono y otros asimétricos como lo es la radio y las redes sociales son de los primeros, donde cualquiera es emisor y receptor a la vez.

Siempre la responsabilidad de lo emitido en unos y otros canales es del emisor, sea radio, o telefono. y no del medio de comunicación Seria absurdo que se reponsabilizara de la calidad de lo escrito en un periódico a los kioskero

Segundamano no es responsable de la veracidad de la información que publica, Tampoco lo es Idealista. No lo son porque son soportes digitales de comunicación entre particulares y las falsedades que aparezcan son responsabilidad de quien las escribe. Hay mentiras en lo que publican, …. ¿Si vieras las descripciones que hace la gente de sus viviendas?,

Hola GORKI!! Tenemos idealizado cómo debería ser la sociedad en general y cómo tendríamos que comportarnos… la realidad tanto de la sociedad en la calle como de la sociendad en el mundo virtual, redes sociales, son parecidas y pienso que cada vez se irán pareciendo aún más. La falta de libertades, la inseguridad y el control por parte de Estados, empresas y usuarios, será en internet como lo es en nuestras sociedades… Internet como se imaginó y se idealizó empieza a ser y será muy diferente de lo que ya es (eso no gusta a nadie en general). Saludos a todos!!

Quería comentar el caso de GitHub con algo mas de detalle:

1) Los cambios que se hicieron fueron tras la denuncia (mas tarde se demostró que falsa) de acoso sexual en las oficinas

2) Se forzó un código de conducta terriblemente liberticida (http://todogroup.org/opencodeofconduct/) donde tienen perlas como:

I) Es acoso chocarle la mano a alguien virtualmente

II) Se niega que exista discriminación en sentido contrario (hacia blancos, cis, hombres…) por lo que no aceptan denuncias de esa indole

3) La empresa tiene como política primar gente de minorías sobre gente cualificada (http://www.breitbart.com/tech/2016/02/08/report-anti-white-agenda-revealed-at-githubs-diversity-team/)